La inteligencia artificial (IA) ha transformado de manera significativa la lucha contra ciberamenazas en el último año, y las tendencias apuntan a que este impulso no cesará en los próximos meses. En este contexto, tanto los equipos de ciberseguridad en las empresas como los usuarios cotidianos de internet se enfrentarán a un panorama cada vez más complejo. Mientras que la tecnología de IA proporciona herramientas que permiten a los defensores mejorar su seguridad, los actores maliciosos están adoptando rápidamente estas mismas herramientas, lo que se traduce en un aumento previsible de estafas, ingeniería social, fraude de cuentas y campañas de desinformación.

El Centro Nacional de Ciberseguridad del Reino Unido (NCSC) alertó a inicios de 2024 que la IA ya estaba siendo utilizada por todos los tipos de actores amenazantes y esperaba que esto incrementara tanto el volumen como el impacto de los ciberataques en un periodo de dos años. Esta amenaza es particularmente aguda en el ámbito de la ingeniería social, donde la inteligencia artificial generativa (GenAI) permite a los delincuentes crear campañas de suplantación altamente convincentes en idiomas locales. Además, la IA puede facilitar la identificación automatizada de activos vulnerables a gran escala.

De cara al año 2025, se anticipan varias tendencias preocupantes en el uso de IA por parte de los delincuentes. Entre ellas se incluyen:

- Evasión de autenticación: El uso de tecnología de deepfake para ayudar a los estafadores a suplantar a clientes en verificaciones de cuenta basadas en selfie y video.

- Compromiso de correos electrónicos de negocios: La genAI se utilizará para engañar a empleados corporativos para que transfieran fondos a cuentas bajo el control de los estafadores.

- Estafas de suplantación: Modelos de lenguaje de código abierto podrían dar a los estafadores la oportunidad de suplantar a víctimas en estafas de "secuestro virtual" y otras.

- Estafas de influencia: Los estafadores emplearán GenAI para crear cuentas que imiten a celebridades e influenciadores, utilizando videos manipulado para atraer seguidores a que entreguen información personal y dinero.

- Desinformación: Grupos hostiles aprovecharán la GenAI para generar fácilmente contenido falso, engañando a los usuarios de las redes sociales.

- Cracking de contraseñas: Herramientas impulsadas por IA podrán descubrir credenciales de usuario en cuestión de segundos.

No obstante, la IA no solo será una herramienta para los actores maliciosos; también podría incrementar la exposición a filtraciones de datos. Los modelos de lenguaje requieren grandes volúmenes de datos para ser entrenados, y esto podría incluir información sensible, lo que plantea riesgos significativos en caso de que la IA sea comprometida.

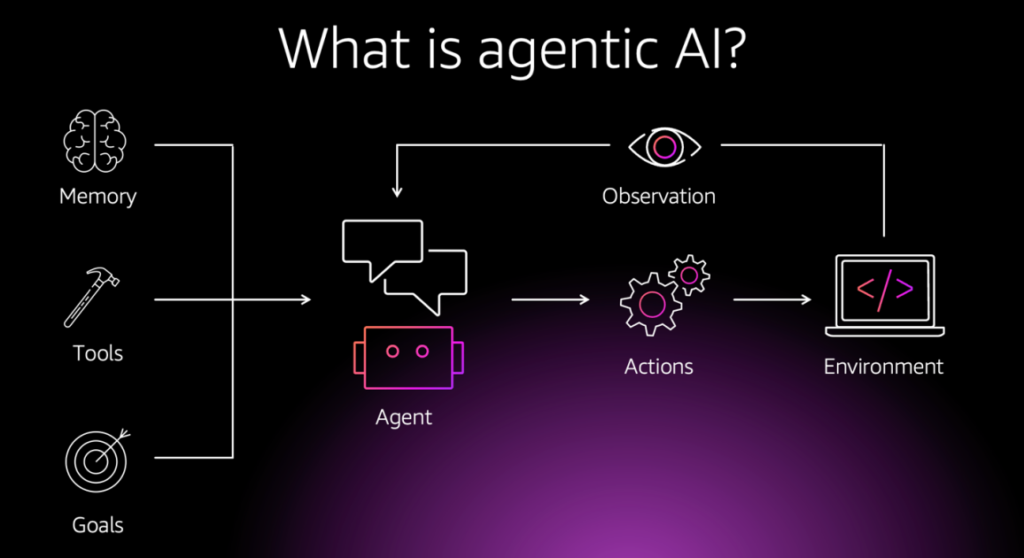

Para las defensas en 2025, la IA se integrará cada vez más en las operaciones de ciberseguridad. Esto incluirá la generación de datos sintéticos para entrenamiento, la aceleración del análisis de informes complejos de inteligencia de amenazas y la mejora de la productividad en equipos de seguridad a través de la automatización. Sin embargo, es esencial que líderes de TI y seguridad reconozcan las limitaciones de la IA y el valor insustituible del juicio humano.

El panorama de amenazas y el desarrollo de la seguridad de la IA no se producen en un vacío. Cambios geopolíticos, especialmente en Estados Unidos, podrían derivar en una desregulación de la tecnología y redes sociales, permitiendo un aumento de las estafas en línea. Mientras tanto, en la Unión Europea, persisten incertezas sobre la regulación de la IA, lo que podría complicar la vida de los equipos de cumplimiento.

Así, el año 2025 traerá consigo un cambio radical en la interacción con la tecnología, ofreciendo tanto beneficios considerables como nuevos riesgos que deben ser gestionados. Es responsabilidad de todos —gobiernos, empresas y usuarios— trabajar colaborativamente para aprovechar el potencial de la IA mientras se mitigan sus amenazas.

Fuente: WeLiveSecurity by eSet.